La datavisualisation (ou “dataviz”) trouve des usages très concrets dans le domaine industriel. Exemple dans le domaine de la gestion de l’énergie.

Lors de la dernière Matinale de la Technopole Rennes Atalante, nous avons eu le plaisir d’intervenir aux côtés d’Arnaud Legrand, cofondateur d’Energiency.… Lire la suite

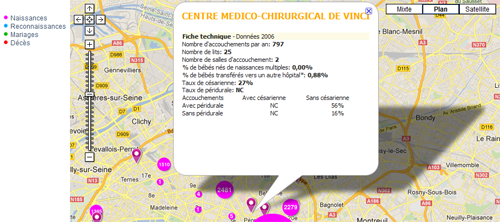

Voir la Viz :

Voir la Viz :